モーションキャプチャデータを用いた人の動作スタイル表現

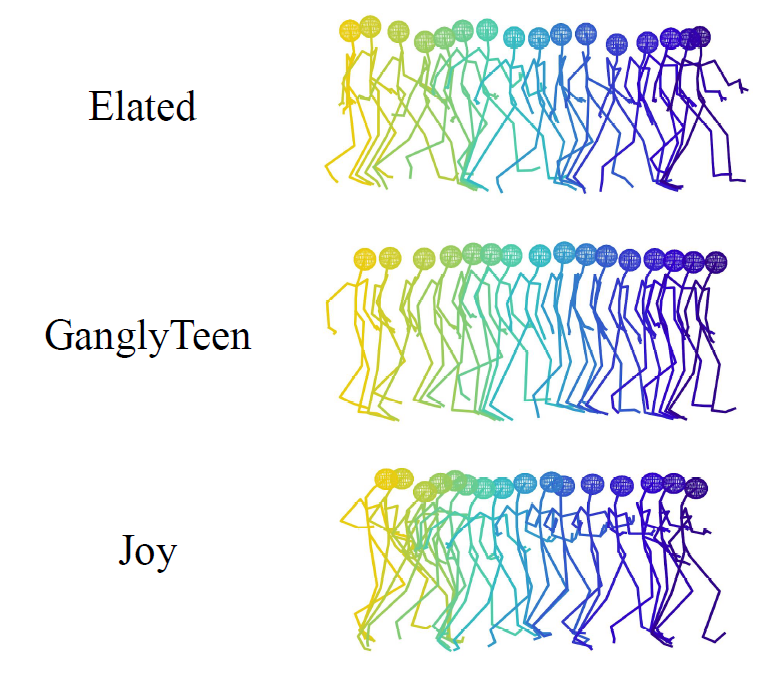

人間の動作には「力強いー弱々しい」「若者ー老人」などの「動作スタイル」が存在します.従来スタイルは,孤立かつ個別のものであるとみなされていましたが,実際には動作スタイルは年齢や心理状態といった連続的な要因に基づいて現れるため,semantic な連続空間として扱うのが妥当です.本研究ではそのような動作スタイルに関する連続空間を,深層学習 とadversarial learning を用いて獲得する研究を行いました.具体的には,Adaptive Instance Normalization によるスタイル制御を導入した新しい動作生成ネットワークを提案,stylized された動作の生成を学習することで,中間層において目的のスタイル空間を獲得することができます. これにより,様々なスタイルの動作を生成するだけでなく,連続空間上での補間や加減算による新規スタイルの生成を行うことが出来る.また,スタイルを保持しながら任意の入力軌跡に従うような動作を生成することで,controllable な動作生成を実現するとともに,明示的に動作のコンテンツとスタイルを分離して学習することが可能です.

人間の動作には「力強いー弱々しい」「若者ー老人」などの「動作スタイル」が存在します.従来スタイルは,孤立かつ個別のものであるとみなされていましたが,実際には動作スタイルは年齢や心理状態といった連続的な要因に基づいて現れるため,semantic な連続空間として扱うのが妥当です.本研究ではそのような動作スタイルに関する連続空間を,深層学習 とadversarial learning を用いて獲得する研究を行いました.具体的には,Adaptive Instance Normalization によるスタイル制御を導入した新しい動作生成ネットワークを提案,stylized された動作の生成を学習することで,中間層において目的のスタイル空間を獲得することができます. これにより,様々なスタイルの動作を生成するだけでなく,連続空間上での補間や加減算による新規スタイルの生成を行うことが出来る.また,スタイルを保持しながら任意の入力軌跡に従うような動作を生成することで,controllable な動作生成を実現するとともに,明示的に動作のコンテンツとスタイルを分離して学習することが可能です.- 渡辺 祐貴,中澤 篤志,幸村 琢,MotionGAN: 関節パラメータの敵対的学習による動作スタイル生成,情報処理学会研究報告(CVIM/CG), 2019-CVIM-219(23), 2019-CG-176, Vol.23, 2019-10-31

センサデータと機械学習を用いた人の行動計測性能向上

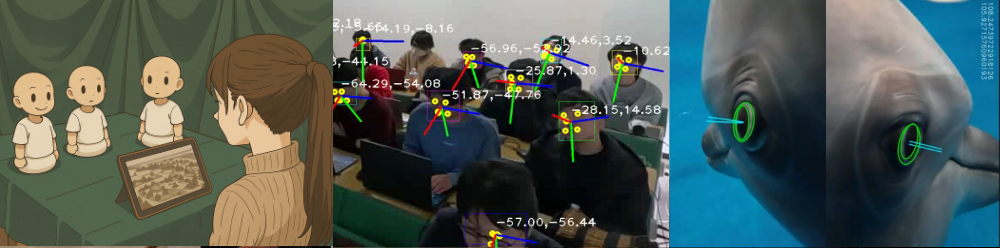

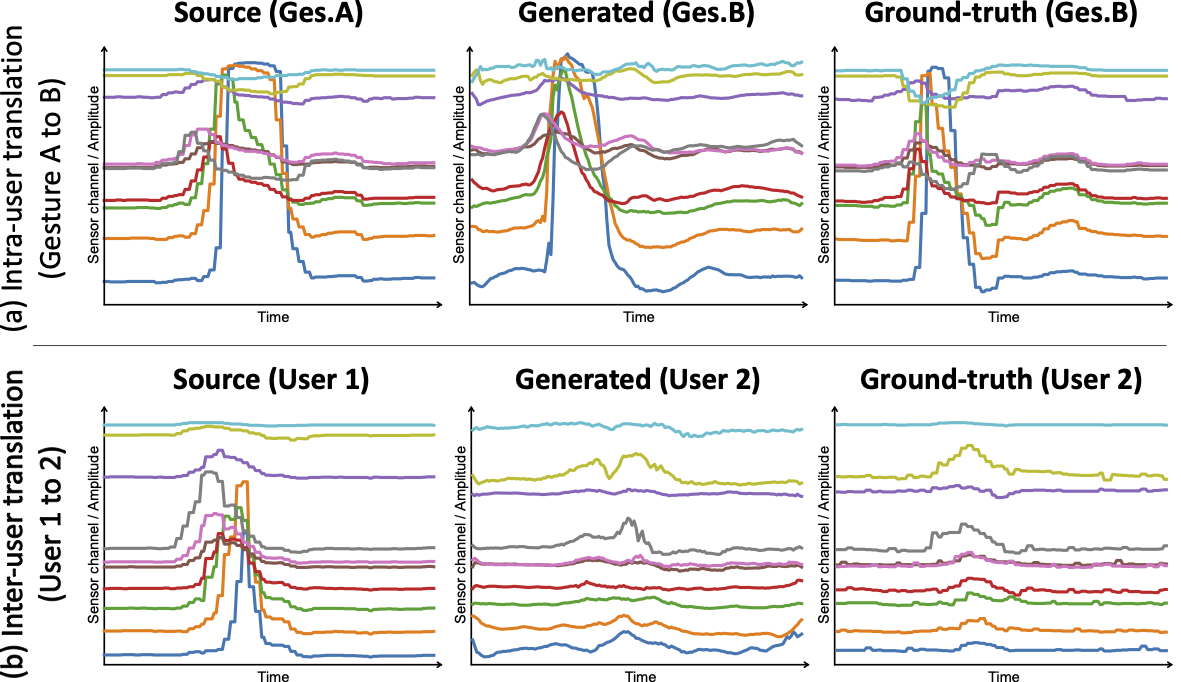

ウェアラブルデバイスのセンサーデータと機械学習を用いた人のジェスチャー認識では,データに現れる個人差(=個性)が認識精度低下の原因として挙げられます.これに対処する方法として,認識モデルのパーソナライズ(fine-tuningなどのキャリブレーションによりモデルを特定ユーザに特化させる)の有用性が既存研究で指摘されていますが,これにはユーザごとに全ジェスチャークラスのデータが多く必要でありユーザの負担となるという問題がありました.そこで本研究では,敵対的生成ネットワークをベースとするstyle transformer networkを導入し,既存データと少量の追加データから学習に必要なデータを自動生成して認識モデルの精度を向上させるフレームワークを提案しました.具体的には,ジェスチャークラス間のデータのスタイル変換(intra-user translation),あるいはユーザ間のスタイル変換(inter-user translation)を学習することで,ターゲットデータを別のデータから変換・生成します.これにより少ないデータ収集量でモデルのパーソナライズか可能となり,ユーザの負担を軽減することができます.

ウェアラブルデバイスのセンサーデータと機械学習を用いた人のジェスチャー認識では,データに現れる個人差(=個性)が認識精度低下の原因として挙げられます.これに対処する方法として,認識モデルのパーソナライズ(fine-tuningなどのキャリブレーションによりモデルを特定ユーザに特化させる)の有用性が既存研究で指摘されていますが,これにはユーザごとに全ジェスチャークラスのデータが多く必要でありユーザの負担となるという問題がありました.そこで本研究では,敵対的生成ネットワークをベースとするstyle transformer networkを導入し,既存データと少量の追加データから学習に必要なデータを自動生成して認識モデルの精度を向上させるフレームワークを提案しました.具体的には,ジェスチャークラス間のデータのスタイル変換(intra-user translation),あるいはユーザ間のスタイル変換(inter-user translation)を学習することで,ターゲットデータを別のデータから変換・生成します.これにより少ないデータ収集量でモデルのパーソナライズか可能となり,ユーザの負担を軽減することができます.- 鈴木 乃依瑠,渡辺 祐貴,中澤 篤志,Style Transfer Networkを用いた動作データの個性化によるジェスチャ認識の精度向上,情報処理学会研究報告(UBI),2019-12-10

-

N Suzuki, Y Watanabe, A Nakazawa – Proceedings of the ACM on IMWUT (UBICOMP2021), 2020